Хүмүүсийн огт хэлээгүй, хийгээгүй зүйлийг харуулсан бичлэг, аудио, зурагнууд бүхий deepfake медиад дэлхий живж байна. Ихэнх deepfake нь өөр хүний биед оруулсан алдартны нүүр царай бүхий эвгүй, таагүй видео, гэрэл зурагнууд байдаг. Тэдгээрийн зарим нь хэрэглэгчдийг мэхлэх, тухайн улс төрч, алдартны нэр хүндийг унагах хорон зорилготой байдаг. Хиймэл оюун үсрэнгүй хөгжиж эхэлснээр deepfake-ийг компьютерын товчлуур дээр хэдхэн товшоод л хийх боломжтой болсон учраас үүнээс сэргийлэхийн тулд Засгийн газрууд хариу арга хэмжээ авах арга замуудыг хайж эхэллээ.

Deepfake-тэй хэрхэн тэмцэж байна вэ?

Хиймэл оюуны үүсгэсэн дуу хоолойг автомат хариулагчид ашиглах нь хууль бус гэсэн шийдвэрийг АНУ-ын Харилцаа холбооны хороо хоёрдугаар сарын 8-нд танилцуулсан. Ерөнхийлөгч Жо Байдены яриаг deepfake ашиглан өөрчилсөн компанид уг үйл ажиллагаагаа зогсоохыг шаардсан албан бичгийг тус хороо явуулснаас хоёр өдрийн дараа уг хориг гарчээ. Тодруулбал, Нью-хэмпшир мужид ерөнхийлөгчийн сонгуулийн урьдчилсан шатны сонгууль болохын өмнө тус мужийн иргэд рүү Ж.Байден ярьж байгаа мэт автомат дуудлага ирж, сонгуульд оролцолгүй гэртээ байж, харин арваннэгдүгээр сарын сонгуульд идэвхтэй оролцохыг нь уриалсан аж. Уг дуудлага нь ерөнхийлөгчийн байнга хэлдэг үгийг хүртэл багтааснаараа онцгой байжээ.

Одоогоор АНУ-д deepfake-ийг ямар нэг хэлбэрээр хориглосон хууль батлагдаагүй байна. Харин зарим муж deepfake ашиглаж хийсэн порно бичлэг, зургийг хориглосон хууль баталсан ч улс даяар хэрэгжихгүй учраас ийм зүйл бүтээгчдэд хариуцлага хүлээлгэх боломж хэлмэгдэгч нарт байдаггүй. Түүнчлэн Европын холбооны санал болгож буй Хиймэл оюуны хуульд deepfake-ийг зүйлчлэх шаардлагыг платформуудад тавихаар болжээ.

Deepfake ямар хэрэг өдүүлээд байна вэ?

Deepfake ашиглаж хийсэн поп дуучин Тэйлор Свифтийн гэрэл зургууд өнгөрсөн нэгдүгээр сард нийгмийн сүлжээгээр тархаж, түүнийг бишрэн шүтэгчдийн уур цухлыг хүргэсэн. Энэ явдалд санаа зовж буйгаа Цагаан ордны зүгээс илэрхийлсэн юм. Түүнчлэн, Marvel цувралд тоглосон 17 настай жүжигчин Сочитл Гомесийн царайг ашиглаж хийсэн секс бичлэгүүд мөн сарын эхээр нийгмийн сүлжээгээр тарсан агаад тэдгээр материалыг онлайнаас устгуулах хүчин чармайлт нь амжилтад хүрээгүй тухайгаа тэрбээр ярьж байв.

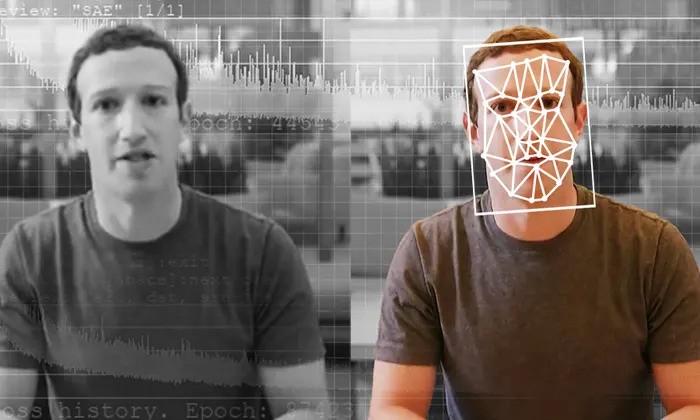

Deepfake видеог хэрхэн хийдэг вэ?

Бодит бичлэгт гарч байгаа хүний онцлог шинж чанаруудыг олж ажиглахад суралцдаг гүн сургалтын процессыг хиймэл оюуны алгоритм нь ашиглаж иймэрхүү төрлийн бичлэг, зургийг үүсгэдэг юм. Ингэснээр нэг бичлэгийн ямар нэг элементийг, тухайлбал нүүр царайг нь огт өөр контентод тун цэвэрхэн оруулж өгдөг юм. Улмаар дуу хоолой хувилах технологи ашиглаж үүсгэсэн яриаг энэхүү бичлэгтээ нэмснээр ийм контент нь бодитой мэт харагдах өндөр магадлалтай болдог.

Яагаад deepfake технологи моодонд оров?

Уг технологи эхэндээ эрдэмтэн, судлаачдын судалгааны талбар байв. Гэвч “Deepfake” нэртэй Reddit-ийн хэрэглэгч нээлттэй эх бүхий код ашиглаад хуурамч видео хийх алгоритм бүтээсэн талаар 2017 онд “Motherboard” вэбсайт мэдээлсэн юм. Тэрхүү хэрэглэгчийг Reddit платформоосоо хассан ч уг арга нь олон нийтэд тархаж эхэлжээ. Deepfake видео хийхийн тулд тухайн үед бэлэн бичлэг, дуу хоолойны бүтэн бичлэг, эдит хийх дээд зэргийн ур чадвар шаардлагатай байсан бол өнөөгийн generative хиймэл оюун нь ердөө хэдхэн код ашиглаад зураг, бичлэг үүсгэх боломжийг олгож байна. Хэн нэгэн хүнийг үг хэлж буй бичлэг үүсгэхийг компьютероос хүсэхэд л ийм видеог тун богино хугацаанд бүтээнэ. YouTube, зураг болон бичлэгийн сан бүхий веб сайтууд гээд асар их материал онлайнд бэлэн байгаа учраас хиймэл оюуны компаниуд улам дэвшилтэт шинэ багажууд ашиглан дижитал бүтээлээ улам л бодитой мэт болгосоор байна.

Deepfake-ийн өөр ямар жишээнүүд байдаг вэ?

АНУ-ын туршиж буй “уур амьсгалын нууц зэвсэг”-ийн улмаас түймэр гарсан гэсэн мэдээллийг тараах үүднээс Хавайн Мауи аралд өнгөрсөн оны наймдугаар сард гарсан гал түймрийн хуурамч зургуудыг Хятадын троллууд онлайнд тарааж байв. 2023 оны тавдугаар сард Пентагоны барилга шатаж буй зураг онлайнд тавигдсаны дараа АНУ-ын хувьцаануудын ханш түр хугацаагаар унаж байсан. Мөн Нигерийн Ерөнхийлөгчийн сонгуульд нэр дэвшсэн Атику Абубукар сонгуулийн дүнг будлиантуулах хуйвалдааны тухай ярьж буй хуурамч аудио мөн оны хоёрдугаар сард тархаж байлаа. Зэвсгээ хураалгаж, Орост бууж өгөхийг Украины Ерөнхийлөгч В.Зеленский цэргүүддээ уриалж буй нэг минутын бичлэг 2021 онд нийгмийн сүлжээнд гарч байсан.

Ямар аюултай вэ?

Хуурамч зүйлийг бодитоос нь ялгах боломжгүй болгохоор хэмжээний боловсронгүй болж хөгжих боломж deepfake-т байгаа гэсэн айдас олон хүнд бий. Компанийн захирлууд үйл ажиллагааныхаа талаар мэдэгдэл гаргаж буй хуурамч бичлэг хийж хувьцааны үнэд нь нөлөөлөх, дайны гэмт хэрэг үйлдэж буй цэргүүдийн бичлэгийг онлайнд тавих гэх мэт зарим хорон жишээг дурдаж болно. Мөн маш их бичлэг, зураг нь онлайнд байдаг улс төрч, бизнесмэн, алдартнууд deepfake-ийн гол хохирогчид болох магадлалтай юм. Түүнчлэн тухайн хүний нүцгэн зураг, видео нь байхгүй тохиолдолд ч хариугаа авах порног уг технологи бүтээж, эмэгтэйчүүдийг байгаа болгох эрсдэлтэй. Иймэрхүү видео, зураг интернэтэд нэгэнт тарсан бол зогсоох, устгах арга бараг байдаггүй.

Хууль бус, аюултай зүйлийг бодитоор хийж байгаа бичлэг нь илэрсэн хүмүүс эдгээр нотолгоо баримтыг хуурамч гэж мэтгэх, зөрүүдлэх боломж гарч байгаа нь санаа зовоосон өөр нэг асуудал билээ. Deepfake ашигласан нотолгоог шүүх дээр ашигласан тохиолдлууд ч гараад байна.

Deepfake-тэй тэмцэхийн тулд юу хийх ёстой вэ?

Deepfake-ийг үүсгэдэг машин сургалтыг буцааж өөрчлөх замаар илрүүлэх боломж тун бага. Гэвч Нидерландын Sensity AI, Эстонийн Sentinel зэрэг стартапууд АНУ-ын технологийн томоохон компаниудын адилаар deepfake-ийг илрүүлэх технологийг боловсруулж байна. Арьсан дээр илрэх судасны өнгөний өөрчлөлтийг олж илрүүлэх замаар хуурамч видеог 96 хувийн оновчтой илрүүлдэг FakeCatcher программыг 2022 оны 11 дүгээр сард Intel Corp танилцуулж байв. Түүнчлэн хиймэл оюун ашиглаж бүтээсэн зургууддаа дижитал тамга тавьж, хуурамч гэдгийг нь таниулах боломжтой гэж Microsoft компани мэдэгджээ.

Эх сурвалж: Bloomberg.com

Нийтлэлийг Нэйт Ланксон